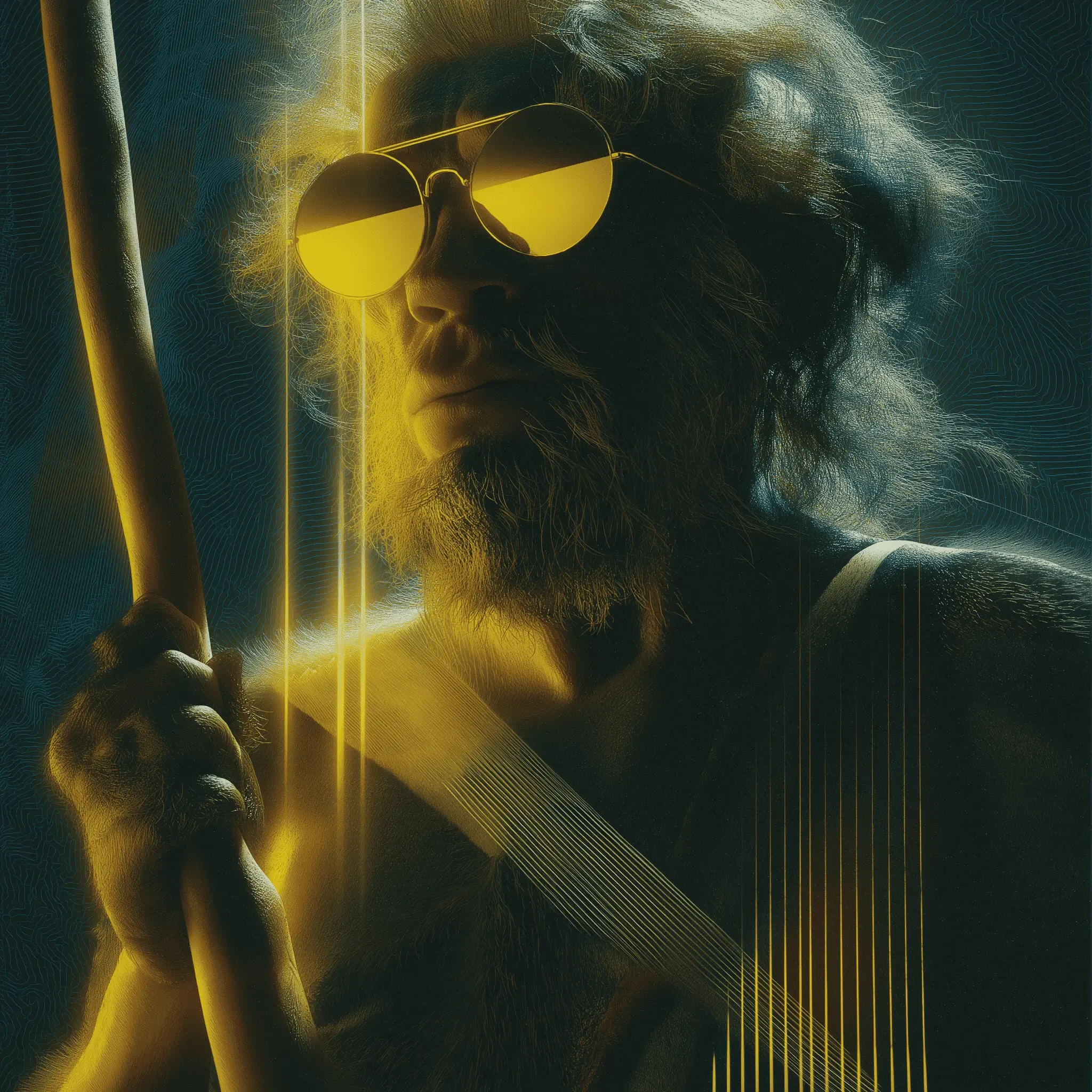

Caveman AI: Token-Komprimierung für KI-Coding-Agenten

Das Problem: KI-Agenten reden zu viel

Kennst du das? Du fragst Claude Code eine simple Frage und die Antwort liest sich wie ein Schulaufsatz. Höflichkeitsfloskeln, Einleitungen, Zusammenfassungen, nochmal eine Zusammenfassung der Zusammenfassung. Du scrollst und scrollst, obwohl die eigentliche Info in zwei Sätze gepasst hätte.

Das nervt nicht nur. Es kostet auch Geld.

Bei tokenbasierten Abrechnungsmodellen zahlst du für jedes einzelne Wort, das der Agent ausspuckt. Wenn 70% davon Füllmaterial sind, wird das schnell teuer. Julius Brussee hat sich das angeschaut und eine ziemlich unkonventionelle Lösung gebaut: Caveman AI. Ein Open-Source-Skill, der KI-Agenten zwingt, komprimiert zu antworten, mit bis zu 75% weniger Output-Tokens laut Projektangaben.

Was ist Caveman AI?

Caveman AI bringt KI-Coding-Agenten dazu, in einem radikal komprimierten Stil zu antworten. Die Idee: Füllwörter raus, Höflichkeitsfloskeln raus, Hedging raus, technische Genauigkeit bleibt drin. Der Name ist Programm, der Agent kommuniziert wie ein Höhlenmensch.

Statt:

“Natürlich! Ich helfe dir gerne dabei, diesen Fehler zu beheben. Lass mich zunächst erklären, was hier passiert. Der Fehler tritt auf, weil die Variable nicht initialisiert wurde. Hier ist die Lösung, die ich vorschlagen würde…”

Bekommst du:

“Bug: Variable nicht initialisiert. Fix: Zeile 12, let count = 0 hinzufügen.”

Über 27.000 GitHub-Sterne für ein Plugin, das erst seit Kurzem existiert. Die Community feiert den Ansatz.

Wie funktioniert das Ganze?

Technisch gesehen klinkt sich Caveman AI als Skill in den Workflow deines Coding-Agenten ein. Bei Claude Code arbeitet das System mit drei Hooks:

- SessionStart aktiviert den Caveman-Modus und schreibt eine Flag-Datei

- UserPromptSubmit erkennt /caveman-Befehle und aktualisiert den Modus

- Ein Statusleisten-Skript zeigt dir an, welcher Modus gerade aktiv ist

Die zentrale Steuerungsdatei ist skills/caveman/SKILL.md, sozusagen die Single Source of Truth fürs gesamte Verhalten. CI-Workflows synchronisieren sie automatisch in alle agentenspezifischen Verzeichnisse. Du musst also nicht in den Eingeweiden verschiedener Konfigurationen herumwühlen. Eine Datei regiert alles.

Die drei Intensitätsstufen

Caveman kommt nicht als One-Size-Fits-All. Du hast drei Stufen:

- Lite: Professionell knapp. Volle Sätze bleiben erhalten, aber alles Überflüssige fliegt raus. Gut, wenn du den Agenten auch mal Kollegen zeigst und nicht wie ein Neandertaler wirken willst.

- Full: Der klassische Höhlenmensch-Modus und gleichzeitig der Standard. Kurze Fragmente, keine Höflichkeitsfloskeln, direkt auf den Punkt.

- Ultra: Maximale Komprimierung. Abkürzungen, Pfeile statt Konjunktionen, fast Telegramm-Stil. Nicht für jeden was, aber wenn du weißt, was du tust, extrem effizient.

Es gibt sogar 文言文-Modi (wenyan), die in klassischem Chinesisch komprimieren. Ob du das jemals brauchst, steht auf einem anderen Blatt, aber es zeigt, wie weit das Konzept gedacht wurde.

Neben den Stufen bietet Caveman spezialisierte Befehle:

caveman-commit

für knappe Commit-Messages,

caveman-review

für einzeilige Code-Reviews,

caveman-compress

für die Komprimierung deiner eigenen Input-Tokens.

Token-Einsparung und Geschwindigkeit

Jetzt wird es spannend, aber auch ein bisschen heikel. Das Projekt behauptet eine Output-Token-Reduktion von etwa 65 bis 75% und einen Geschwindigkeitszuwachs um den Faktor 3. Das Tool

caveman-compress

soll zusätzlich rund 46% der Input-Tokens einsparen.

Aber, und das muss man ehrlich sagen: Diese Zahlen stammen aus dem Projekt selbst. Projektinterne Benchmarks, keine unabhängig verifizierten Studien. Die README spricht sogar von “100% technical accuracy”, was eine ziemlich steile Behauptung ist.

Auf der Projekt-Landingpage wird ein Paper zitiert, “Brevity Constraints Reverse Performance Hierarchies in Language Models”, das belegen soll, dass erzwungene Kürze die Genauigkeit sogar verbessert. Klingt gut, konnte bisher aber nicht unabhängig bestätigt werden.

Heißt das, die Zahlen sind Quatsch? Nicht unbedingt. Die grundlegende Beobachtung, dass LLMs unnötig wortreich sind und Komprimierung funktioniert, ist plausibel. Aber nimm die konkreten Prozentwerte mit einer gesunden Portion Skepsis. Gerade bei Agentic AI Workflows, wo Agenten autonom mehrere Schritte hintereinander ausführen, kann verboses Antwortverhalten zum echten Kostenfaktor werden, selbst moderate Einsparungen summieren sich da schnell.

Unterstützte Agenten und Installation

Caveman unterstützt eine ganze Reihe von Agenten: Claude Code, Codex, Gemini CLI, Cursor, Windsurf, Cline, GitHub Copilot und laut Projektangaben über 40 weitere über

npx skills add

in Claude Code, Gemini CLI und dem lokalen Codex-Setup funktioniert die Auto-Aktivierung nativ. Bei anderen Agenten musst du eine Always-on-Regel manuell hinzufügen, kein großer Aufwand, aber gut zu wissen.

Die Installation selbst? Ein npx-Befehl, kurz warten, fertig.

Auto-Clarity: Wenn es ernst wird

Einer der durchdachteren Aspekte: Auto-Clarity. Der Agent schaltet automatisch in den normalen, ausführlichen Sprachstil zurück, wenn es um Sicherheitswarnungen, irreversible Aktionen oder mehrstufige Sequenzen geht.

Bei einem rm -rf willst du definitiv keine Höhlenmensch-Antwort, sondern eine klare, unmissverständliche Warnung. Code-Blöcke, Git-Commits und PR-Beschreibungen bleiben ebenfalls unverändert, technische Fachbegriffe exakt beibehalten.

Gerade wenn du mit komplexeren Setups arbeitest, etwa Multi-Agent-Systemen, in denen mehrere Agenten zusammenarbeiten, ist diese Sicherheitsebene wichtig. Ein Agent, der in kritischen Momenten kryptisch antwortet, wäre ein echtes Problem.

Lohnt sich Caveman AI?

Caveman AI löst ein reales Problem. LLMs sind verbose, das kostet Zeit und Geld, und komprimierte Antworten sind oft tatsächlich besser lesbar. Das Konzept ist elegant, die Umsetzung durchdacht, und die GitHub-Community sieht das ähnlich.

Trotzdem: Die Leistungsangaben sind bisher nicht unabhängig bestätigt. Der Ultra-Modus kann bei komplexen Erklärungen zu knapp werden, sodass du den Kontext verlierst. Und wenn du den Agenten als Lern-Tool nutzt, willst du vielleicht gar keine komprimierten Antworten.

Für erfahrene Entwickler, die genau wissen, was sie brauchen, und ihren Coding-Agenten als Werkzeug statt als Tutor einsetzen, ist Caveman AI definitiv einen Blick wert. Starte mit dem Lite-Modus und arbeite dich hoch. Im schlimmsten Fall schaltest du es wieder ab.

Unsere Quellen

- caveman/README.md at main · JuliusBrussee/caveman

- GitHub - JuliusBrussee/caveman: 🪨 why use many token when few token do trick - Claude Code skill that cuts 65% of tokens by talking like caveman

- caveman/CLAUDE.md at main · JuliusBrussee/caveman

- caveman/caveman.skill at main · JuliusBrussee/caveman

- So Expensive, A Caveman Can Do It | Hackaday

- caveman/CLAUDE.original.md at main · JuliusBrussee/caveman

- caveman/hooks/README.md at main · JuliusBrussee/caveman

- caveman/skills/caveman/SKILL.md at main · JuliusBrussee/caveman